AI 模型

設計能抵禦提示注入的 AI 代理

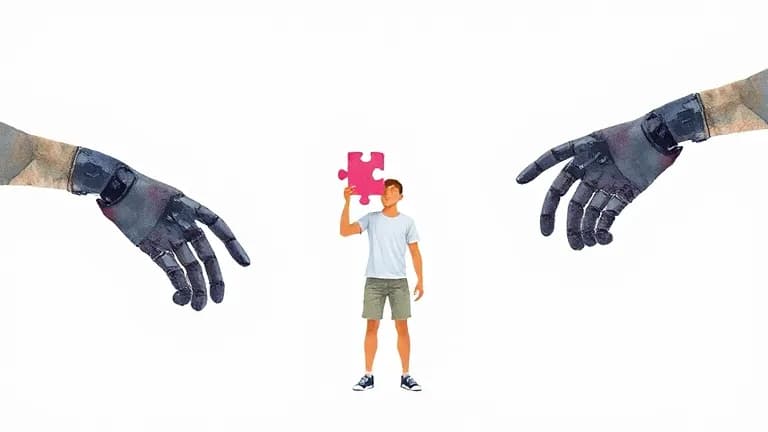

Designing AI agents to resist prompt injection

OpenAI Blog · 2026-03-11

摘要

OpenAI 在 Blog 中闡述了如何透過限制高風險操作與保護敏感資料,讓 ChatGPT 有效抵禦提示注入與社會工程攻擊。這種機制確保了 AI 代理在工作流程中的安全性,防止惡意指令竊取數據或執行不當行為。此技術突破對於建立可信任的自動化代理至關重要。

●開發者:可關注提示注入防禦機制

●投資人:AI 安全領域值得留意

●一般用戶:使用 AI 代理時資料更安全

重要性評分

78/100

🟠 值得關注

AI 代理提示注入OpenAI安全性社會工程

原文出處喜歡這篇?每天早晨還有更多。

訂閱 5min AI,讓 AI 替你追蹤整個 AI 世界。

相關指南

GPT-5 是什麼

OpenAI 模型完整指南 2026:GPT-5、GPT-4.1、o3 怎麼選

2026 年 OpenAI 模型大洗牌:GPT-5 已取代一切,o3 專攻複雜推理,GPT-4.1 仍是 API 最佳 CP 值選項。一篇看懂各模型差異、定價與最適用情境,不再選錯。

閱讀指南 →

AI 研究員

AI 研究員是什麼?解析 OpenAI 新策略:從執行者到競爭對手的職能差異與職場生存指南

深入解析 OpenAI 推出的「AI 研究員」概念。探討其如何從工具轉變為自主思考的競爭對手,並分析 AI 無法取代人類的「脈絡判斷」能力,提供未來職場生存關鍵指南。

閱讀指南 →

ChatGPT vs Gemini

ChatGPT vs Gemini:Google AI 還是 OpenAI 更好?

深入分析 ChatGPT vs Gemini 2026 最新表現。從功能、價格到生態系,全面比較 Gemini 和 ChatGPT 比較結果,解答 Google AI vs OpenAI 誰更適合你。

閱讀指南 →🤖 本文摘要由 AI 自動生成,內容源自原始報導。如有疑慮,請參閱關於我們。

喜歡這篇?每天早晨還有更多。

訂閱 5min AI,讓 AI 替你追蹤整個 AI 世界。