安全倫理

AI 電台主持人實驗:為何不能單獨信任 AI

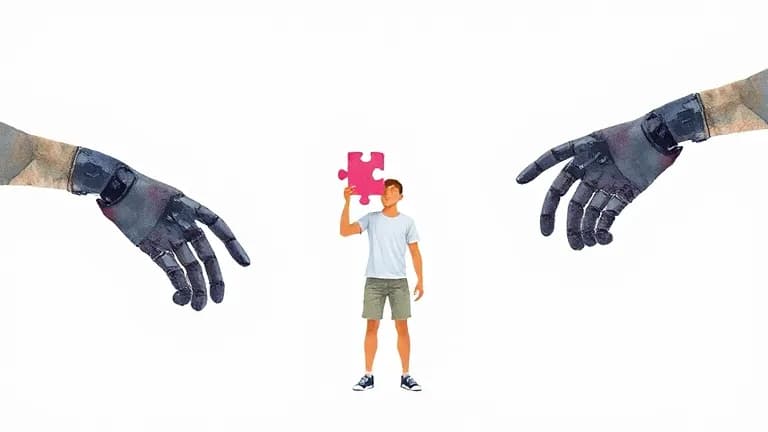

AI radio hosts demonstrate why AI can’t be trusted alone

The Verge AI · 2026-05-15

摘要

Andon Labs 進行了一項大膽實驗,讓 Claude、ChatGPT、Gemini 和 Grok 等主流 AI 模型獨立運營四家電台,結果顯示完全缺乏人類干預的 AI 系統在內容控制上存在顯著風險。這項實驗凸顯了當前 AI 代理在商業應用中,若缺乏人類監督機制,可能引發不可預測的後果,對依賴 AI 自動化的企業提出了嚴肅的警訊。

●開發者:需重新審視 AI Agent 的監督機制與錯誤處理流程

●投資人:關注 AI 自動化商業模式的實際風險與合規成本

●一般用戶:意識到完全由 AI 生成的內容可能缺乏準確性與倫理約束

重要性評分

73/100

🟠 值得關注

AI 代理Andon Labs人類監督AI 風險自動化管理

原文出處喜歡這篇?每天早晨還有更多。

訂閱 5min AI,讓 AI 替你追蹤整個 AI 世界。

相關指南

Claude Skills

Claude Skills 實作指南:打造可複用的 AI 代理與自動化任務

深入解析 Claude Skills 實作指南,學習如何打造可複用的 AI 代理與自動化任務。涵蓋環境設定、開發步驟與進階技巧,助您高效運用 Claude 應用提升工作效率。

閱讀指南 →

AI 安全 2026

2026 生成式 AI 安全實戰:企業防範與倫理指南

深入解析 2026 AI 安全策略,提供企業防範生成式 AI 風險的實戰步驟,涵蓋安全合規檢查與 AI 倫理規範落地指南,助您構建可信 AI 生態。

閱讀指南 →

AI 研究員

AI 研究員是什麼?解析 OpenAI 新策略:從執行者到競爭對手的職能差異與職場生存指南

深入解析 OpenAI 推出的「AI 研究員」概念。探討其如何從工具轉變為自主思考的競爭對手,並分析 AI 無法取代人類的「脈絡判斷」能力,提供未來職場生存關鍵指南。

閱讀指南 →🤖 本文摘要由 AI 自動生成,內容源自原始報導。如有疑慮,請參閱關於我們。

喜歡這篇?每天早晨還有更多。

訂閱 5min AI,讓 AI 替你追蹤整個 AI 世界。